L’IA (ou intelligence artificielle) est forcément apparue dans votre vocabulaire, que ce soit dans un contexte professionnel et personnel. Ces dernières années, et notamment ces derniers mois, l’IA est presque devenue un outil du quotidien (pour ceux ayant osé se l’approprier). Passant d’IA génératives à des logiciels et machines complétement autonomes, l’intelligence artificielle fait son bout de chemin pour s’immiscer dans nos pratiques quotidiennes.

Quelle place pour l’IA dans le monde du travail ?

L’IA ou intelligence artificielle : que sait-on d’elle ?

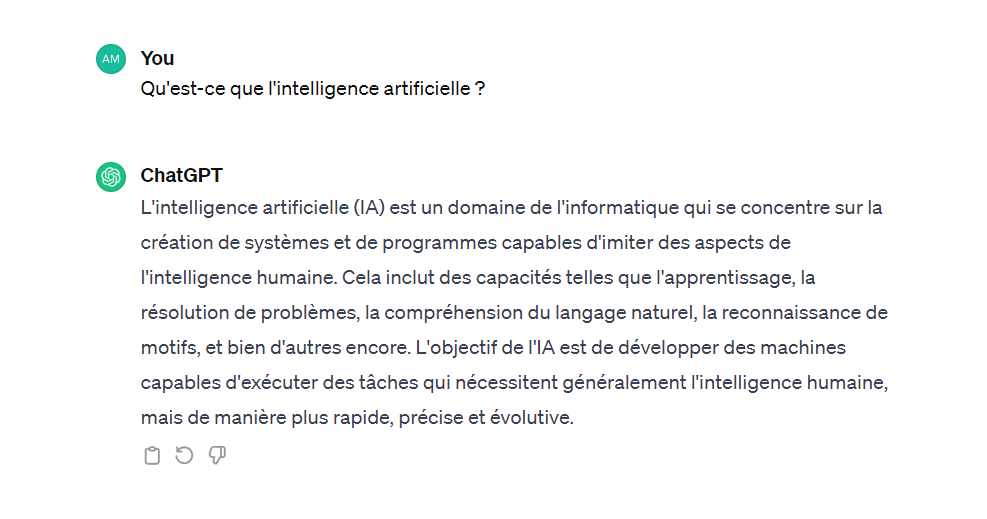

L’IA (ou intelligence artificielle) est une technologie qui imite l’intelligence humaine. Selon ChatGPT lui-même « L’intelligence artificielle (IA) est un domaine de l’informatique qui se concentre sur la création de systèmes et de programmes capables d’imiter des aspects de l’intelligence humaine. Cela inclut des capacités telles que l’apprentissage et la résolution de problèmes […]. »

Les grands exemples d’IA auxquels on peut penser :

- Deep Blue (1997) et Watson (2007) d’IBM ou encore Alpha Go (2015), quelques exemples d’IA, qui ont réussi à surpasser l’humain dans plusieurs situations.

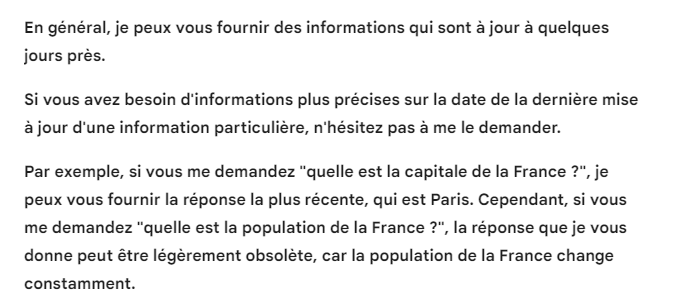

- Les IA génératives (ChatGPT, BARD, etc.), plus récentes. Les évolutions de ces deux dernières années ont donné naissance à des nouvelles manières de travailler. Un des freins ici, la mise à jour de la base de données qui varie. ChatGPT 3.5 pour qui la dernière mise à jour date de janvier 2022. Alors que pour Bard : « En général, je peux vous fournir des informations qui sont à jour à quelques jours près. ».

- Réponse de Gemini à la question : « quand a été mise à jour ta base de données pour la dernière fois ? «

Un cadre réglementaire pour l’IA.

Bien qu’en quelques mois, l’IA a su se faire une place de choix dans nos habitudes, elle n’en reste pas moins crainte. On se rappelle les débordements et de l’utilisation excessive de l’IA à sa sortie. Il n’existe, aujourd’hui, pas de réelle législation pour encadrer son utilisation ni son développement. Un « premier cadre réglementaire » a été proposé en avril 2021 par l’UE. Elle vise à classer toutes les IA utilisables par le grand public en fonction des risques qu’elles présentent. Le but premier du Parlement européen est de veiller à ce que l’IA soit sûr, transparente, traçable et respectueuse de l’environnement. L’objectif n’est pas de rendre l’IA entièrement automatisée, mais plutôt de permettre aux individus qui l’ont programmée de la manipuler et de la mettre à jour selon les besoins. Le Parlement voit déjà plusieurs niveaux des risques :

- Le niveau inacceptable : qui concernent les IA qui pourraient user de la manipulation, du « score-sociale », c’est-à-dire le classement des personnes en fonction de leur comportement, leur statut …

- Le niveau élevé : les IA qui auront un impact sur la sécurité et droits fondamentaux,

- Le niveau limité : ces IA doivent respecter des exigences de transparence. C’est-à-dire que les utilisateurs doivent avoir le contrôle et doivent être informé qu’ils utilisent ces IA (tels que les IA générant des contenus photos ou vidéos).

- Le niveau « bas » ou sans obligation : bien que ce niveau mette en avant les systèmes d’IA ne présentant sensiblement aucun risque, la future loi envisage de créer un code de conduite, afin de ne pas se tourner vers des IA à haut-risques.

- Un accord a été trouver en décembre 2023 sur la loi de l’IA. Elle doit maintenant être adoptée par le Parlement pour entrer en vigueur.

L’intervention humaine reste indispensable car il faut nourrir l’IA ; gérer la maintenance, les problèmes techniques, les risques. La main invisible de « l’humain » reste importante derrière l’IA.

Bien qu’aucune loi ne régisse réellement encore l’utilisation et l’encadrement des IA, ces dernières sont tout de même soumises aux règles de leur « développeur ». Ce que l’on peut appeler les règles internes ou les principes de confidentialités et de sécurités. Comme pour Bard qui se doit de respecter les règles émises par Google ou ChatGPT, celle de OpenAI. Confidentialité, neutralité, sécurité des données, et respect des droits sont les principes qui reviennent. Là où les contenus discriminatoires, haineux, faux ou trompeur, à caractères explicites sont interdits.

IA et monde du travail.

Bien qu’il y ait des avantages à l’utilisation de l’IA …

- Gain de temps,

- Analyse rapide d’une grande base de données, d’informations,

- Réduction des coûts,

- Analyse des tendances.

… On évalue aussi des risques :

- Technologie encore récente, il n’y a donc pas de réel cadre légal,

- Problème potentiel de confidentialité,

- Automatisation de certaines tâches, postes,

- Moins de transfert de compétences,

- Perte de réflexion et d’analyse par son utilisation excessive.

Comme le rapporte La Tribune dans son article en mai 2023 « En 2020, le rapport « Future of Jobs » du World Economic Forum, évaluait à 85 millions le nombre d’emplois remplacés par l’intelligence artificielle à l’horizon 2025, contre 97 millions d’emplois créés. »*. En effet, cette recherche insiste sur le fait qu’une grande partie des métiers et emplois des années 2030, n’existeraient pas encore. Une substitution de métiers pour mieux s’habituer aux évolutions de notre société.

Trouver un terrain d’entente.

Ne pas se laisser remplacer mais ne pas remplacer non plus. L’IA est aussi aujourd’hui utilisée dans les entreprises, si ce n’est pas par les derniers robots et cobots existants. Avantages et inconvénients cohabitent, donnant le choix à chacun de revoir sa façon de travailler avec ces machines et logiciels. Vous pouvez retrouver des informations sur la robotisation au travail dans cet article. À l’avenir, la manutention se verra peut-être elle aussi intégrer l’IA dans ses missions :

- En logistique, pour une gestion de stock intelligente et efficace, elle pourra prévenir en temps réel l’évolution des stocks.

- Mais aussi pour préparer les commandes, qui fera des économies au niveau du temps.

- Elle pourra être plus respectueuse de l’environnement dans ses tâches.

- Une prévention plus accrue des risques et accidents, par l’ajout de fonctionnalités sur les machines ou par l’automatisation des tâches dangereuses.

En bref :

- Efficacité et sécurité de la manutention qui seront améliorées,

- Création de nouveaux d’emplois et de nouvelles façons de travailler,

- Questionnement sur les défis éthiques et juridiques quant à la collaboration entre IA et travailleurs (question de la responsabilité en cas d’accidents).

Le but aujourd’hui est d’apprendre à utiliser ces technologies dans une optique de collaboration. C’est-à-dire savoir utiliser sans excès et à bon escient ces technologies dans notre quotidien.

LIFTOP décidera peut-être un jour de passer le cap. En attendant, l’entreprise propose des solutions de manutention ergonomique variées. Le but premier n’étant pas de remplacer l’opérateur mais bien de l’accompagner dans ses missions au travail.

manutention ergonomique avec un tube de levage

Sources : https://www.europarl.europa.eu/topics/fr/article/20230601STO93804/loi-sur-l-ia-de-l-ue-premiere-reglementation-de-l-intelligence-artificielle *https://www.latribune.fr/partenaires/le-portage-salarial/l-ia-est-elle-une-menace-pour-l-emploi-961963.html https://www.cnil.fr/fr/intelligence-artificielle/intelligence-artificielle-de-quoi-parle-t-on